대화형 인공지능 챗봇 모델인 ChatGPT-4가 발표되었습니다. 이전 모델에 비해 이 모델은 성능과 상호 작용이 크게 향상되어 이미지를 처리하고 더 많은 정보를 인식하고 답변을 제공할 수 있습니다. 또한 성능을 향상시키고 민감한 응답을 방지합니다.

ChatGPT4 업데이트 정보입니다. ChatGPT4의 새로운 기능.

색인

OpenAI의 새로운 인공지능 대화형 챗봇 모델인 ChatGPT-4가 발표되었습니다. 이전 모델과 비교하여 이 모델은 성능과 상호 작용이 크게 향상되었습니다.

ChatGPT는 글쓰기, 추천, 일반 지식 문제 풀기, 수학 문제 풀기 등 다양한 기능을 제공하며 사용자가 검색 엔진처럼 사용할 수 있습니다. 최신 업그레이드에서는 이미지 입력도 가능합니다.

Microsoft의 Bing 검색 도구는 이미 다른 곳에서 이전 GPT-3.5 모델을 대체할 ChatCPT-4 모델과 함께 제공됩니다.

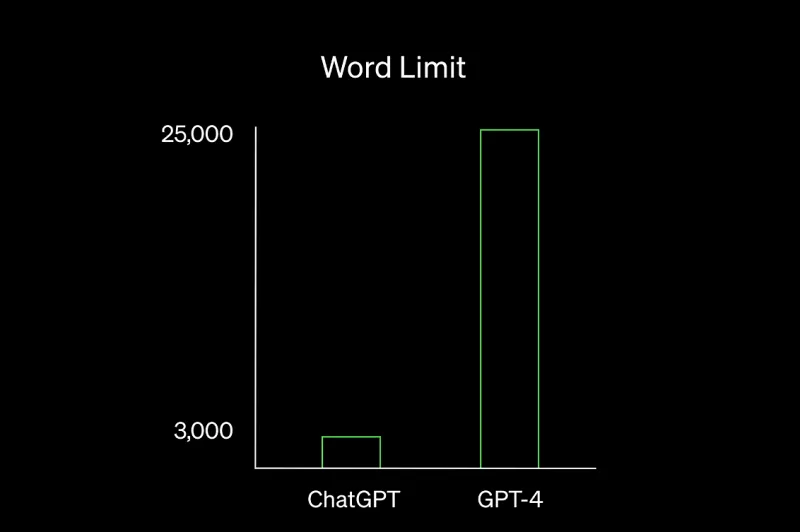

ChatGPT 단어 수의 8배 처리

OpenAI에 따르면 무료 버전의 ChatGPT와 달리 GPT-4 모델은 최대 25,000단어를 처리할 수 있어 챗봇이 더 많은 컨텍스트를 이해하고 더 긴 텍스트 입력을 처리할 수 있습니다.

이 모델을 사용하면 긴 기사에서 전체 웹 사이트를 인식하고 요약하거나 긴 기사의 내용을 요약할 수 있습니다.

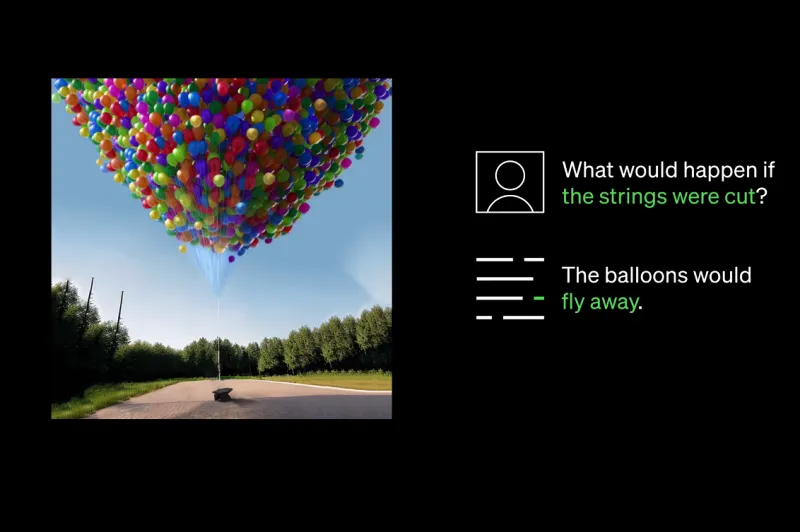

이미지 입력

채팅 GPT에 새로운 기능이 추가되었습니다. 이제 이미지도 입력할 수 있습니다. 출력은 텍스트이며 음성으로 들을 수 있습니다.

OpenAI에 따르면 이 기능은 맹인을 위한 Be My Eyes 앱과 함께 곧 출시될 가상 자원봉사 도구의 일부입니다.

“사용자는 다양한 작업에 대한 식별, 번역 및 대화형 시각적 지원을 위해 앱에서 AI 기반 가상 자원봉사자에게 이미지를 보낼 수 있습니다.”라고 발표했습니다.

일반 Be My Eyes 사용자는 의류, 식물, 체육관 장비, 레스토랑 메뉴 등을 인식하는 자원 봉사자와 화상 통화를 할 수 있습니다. 하지만 나중에 사용자가 사진을 찍으면 iOS 및 Android의 Chat GPT가 대신 촬영할 수 있습니다. 그리고 앱은 해석한 내용을 알려줍니다.

OpenAI에 따르면 시각적 입력은 GPT-4의 순수 텍스트 입력 기능보다 우수합니다.

상당한 성능 향상

OpenAI는 GPT-4가 미국 변호사 시험의 상위 10%에 든다고 발표했습니다. 버전 3.5는 하위 10%에 불과했습니다.

OpenAI는 “여전히 많은 영역에서 인간의 성능이 부족하지만 여러 전문 및 학술 테스트에서 인간 수준의 성능을 보여줬고, 하위 절반은 10%에 머물렀다”고 말했다.

개발자들은 작업이 어려워질수록 성능 격차가 더 커진다고 말했습니다. 일정 수준 이상이면 “GPT-4는 GPT-3.5보다 안정적이고 창의적이며 더 복잡하고 세분화된 정책을 따를 수 있다”고 말했다.

민감하고 허용되지 않는 콘텐츠

ChatGPT-4는 이전 버전에 비해 훨씬 더 안전한 모델입니다. 이 모델이 잠재적으로 악의적인 요청을 처리하는 방법을 알려줄 가능성은 거의 없습니다. 예를 들어 폭탄을 만드는 방법에 대한 정보는 더 이상 제공하지 않습니다.

또한 GPT-4는 이전 버전보다 민감한 요청에 더 자주 응답하며 정책을 준수하면 더 안전하게 사용할 수 있습니다.

이 모델은 사용자가 보안에 노출될 가능성이 있는 정보를 더 이상 제공하지 않으며 사용자 보안을 보호하기 위해 더 많은 작업을 수행합니다.

(함께 읽을 가치가 있음)

구글 크롬. 렌즈 검색을 비활성화하고 이미지 검색을 다시 사용하는 방법. (PC, 휴대폰)

구글 크롬. 렌즈 검색을 비활성화하고 이미지 검색을 다시 사용하는 방법. (PC, 휴대폰)

Google 렌즈는 이미지 검색을 넘어 페이지의 영역(텍스트 또는 이미지)을 선택하여 콘텐츠를 식별하고 검색할 수 있습니다. 이 모든 것이 Chrome 확장 프로그램 없이 가능합니다. 하지만 크롬 렌즈 검

onna.kr

Google 검색에 대해 알아야 할 19가지 Google 도움말

Google 검색에 대해 알아야 할 19가지 Google 도움말

대부분의 사람들은 거의 매일 Google을 사용하지만 많은 사람들이 검색을 훑어봅니다. “구글링”은 Google에서 원하는 결과를 보다 구체적으로 요청하고 찾는 방법입니다.

onna.kr

모바일에서 구글 이미지 검색하는 방법. (아이폰, 갤럭시 등)

모바일에서 구글 이미지 검색하는 방법. (아이폰, 갤럭시 등)

데스크톱 컴퓨터에서는 Google에서 이미지를 쉽게 검색할 수 있습니다. images.google.com으로 이동하여 카메라 아이콘을 클릭하고 온라인에서 본 이미지의 URL을 붙여넣거나 하드 드라이브에서 이미지를 검색합니다.

onna.kr

이상으로 포스팅을 마치겠습니다

앞으로 더 다양한

특별히 중요한 건 아니지만 아시는 분은 어딘가에 쓸 일이 있어서 다시 찾아오겠습니다.

감사해요